はじめに WEB制作会社のAI利用ガイドラインとは?

近年、ChatGPT・Gemini・Claude などの生成AIツールは目覚ましい進化を遂げ、業務の効率化・品質向上に大きく貢献しています。当社においても、市場調査、企画書作成、原稿・画像作成、コーディング、プログラミング、デザイン補助等全工程でAIの活用が進んでいます。

便利な反面、生成AIの利用に際しては、入力した情報がAIの学習データとして利用されたり、チャット履歴が意図せず外部に流出するリスクも指摘されています。個人情報や顧客の機密情報を誤って入力してしまうと、情報漏えいにより取引先との信頼関係を損ない、法的責任を問われる事態につながりかねません。

株式会社ディーアイケイでは、AIのリスクを正しく理解し、WEB制作会社が安全・安心にAIを活用するためのルールを制定し、「AIを使ってはいけない」ではなく、「正しく使って業務の可能性を広げる」ための教育研修とマニュアルの実務運用を開始しました。

ルールブック紹介

AIをめぐる様々なニュースが出ていますが、漠然と「AIが怖い」ではなく、具体的に何が問題なのかを抽出しました。

【1】企業がAIを活用する際の主なリスク

1.バイアスの問題

2.誤情報・ハルシネーションの問題

3.説明できない判断(ブラックボックス)問題

4.情報漏えい問題

5.セキュリティリスク

6.著作権・知的財産のリスク

7.過度な依存・人間の判断力低下

【2】AI時代の情報漏えい対策ガイドライン

1.機密情報の定義

2.情報の危険度でレベル分け(レベルA~C)と対策

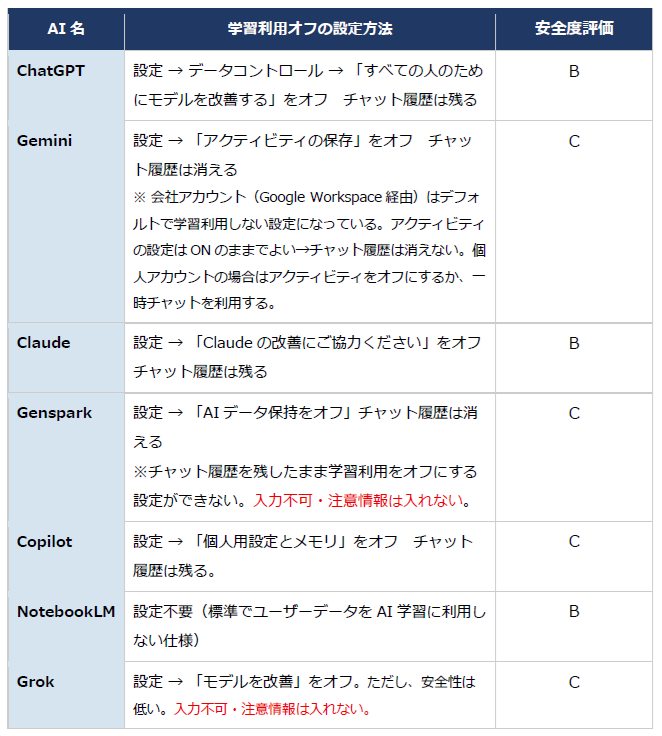

3.AIツール毎のセキュリティ設定

4.漏えいが疑われた場合の対応

5.運用について

【3】AI利用時の情報漏えい対策マニュアル

1.情報危険度(レベルA~B)判断基準

2.工程別取り扱い情報のレベル例

→営業、調査・企画、WEBデザイン、原稿制作、画像生成・加工、WEBサイト保守・運用各工程で、AI利用の可能性を抽出し、それぞれの情報レベルを具体的に記載

3.運用ルール

4.5つの習慣

5.対象となるAIサービス分類

AIを以下に分類し、それぞれにおいて注意事項、利用の可否を記載。

・直接利用型AI(ChatGPT、Gemini、Claude等)

・間接利用型AI(AIエージェント、NotionAI等)

・組込型AI(WEBブラウザの「AIに相談するボタン」、Word・Excel生成、PDF等の要約、音声データの要約ボタン等)

【4】秘密保持契約書(AI対応NDA)

従来の秘密保持契約書(NDA)にAI対応の項目を加えました。

1.顧客用NDA

2.社員、外注先用DNA

おわりに

当社は今まで、AIを便利に有効に利用することを社内外に啓発してきました。

しかし、昨今、AIをめぐる様々なトラブルを目の当たりにして、その危険性も十分感じています。

車の運転のように、便利な反面、リスクもあり、正しいルールを学び、日常業務で運用していく体制づくりが欠かせません。

リスクを知ったうえで「AIを使わない」ではなく、「正しく使う」ことを社内はもちろん、お客様にも訴求していきたいと思います。

ルールを作って終わりではなく、これからが始まりです。

社員一丸となって安全・安心への取り組みを行います。

貴社のAIガイドライン・ルールブック策定、社員教育、運用のお手伝いをします。

文責:株式会社ディーアイケイ 金子弘行